| 文件名 | 含義 |

|---|---|

| memory.usage_in_bytes | 已使用的內存量(包含cache和buffer)(字節),相當于linux的used_meme |

| memory.limit_in_bytes | 限制的內存總量(字節),相當于linux的total_mem |

| memory.failcnt | 申請內存失敗次數計數 |

| memory.stat | 內存相關狀態 |

memory.stat的文件包含的內容

| 字段 | 含義 |

|---|---|

| cache | 頁緩存,包括 tmpfs(shmem),單位為字節 |

| rss | 匿名和 swap 緩存,不包括 tmpfs(shmem),單位為字節 |

| mapped_file | memory-mapped 映射的文件大小,包括 tmpfs(shmem),單位為字節 |

| pgpgin | 存入內存中的頁數 |

| pgpgout | 從內存中讀出的頁數 |

| swap | swap 用量,單位為字節 |

| active_anon | 在活躍的最近最少使用(least-recently-used,LRU)列表中的匿名和 swap 緩存,包括 tmpfs(shmem),單位為字節 |

| inactive_anon | 不活躍的 LRU 列表中的匿名和 swap 緩存,包括 tmpfs(shmem),單位為字節 |

| active_file | 活躍 LRU 列表中的 file-backed 內存,以字節為單位 |

| inactive_file | 不活躍 LRU 列表中的 file-backed 內存,以字節為單位 |

| unevictable | 無法再生的內存,以字節為單位 |

| hierarchical_memory_limit | 包含 memory cgroup 的層級的內存限制,單位為字節 |

| hierarchical_memsw_limit | 包含 memory cgroup 的層級的內存加 swap 限制,單位為字節 |

查看memory.limit_in_bytes文件

/sys/fs/cgroup/memory # cat memory.limit_in_bytes 2147483648

計算容器的限制內存為2g,和yaml文件里面定義的限制內存一樣。查看memory.usag_in_bytes文件

/sys/fs/cgroup/memory # cat memory.usage_in_bytes 2739376

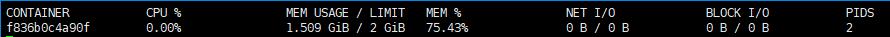

通過docker stats 容器id查看容器的占用內存,和memory.usage_in_bytes的數據相符。

~ # dd if=/dev/zero of=test bs=1M count=1500 1500+0 records in 1500+0 records out 1572864000 bytes (1.5GB) copied, 1.279989 seconds, 1.1GB/s

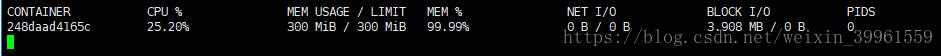

再次通過docker stats 容器id查看容器的占用內存

查看memory.usage_in_bytes文件

/sys/fs/cgroup/memory # cat memory.usage_in_bytes 1619329024

發現容器的占用內存達到了1.5g,查看memory.stat

/sys/fs/cgroup/memory # cat memory.stat cache 1572868096 rss 147456 rss_huge 0 mapped_file 0 dirty 1572868096 writeback 0 swap 0 pgpgin 384470 pgpgout 433 pgfault 607 pgmajfault 0 inactive_anon 77824 active_anon 12288 inactive_file 1572864000 active_file 4096 unevictable 0 hierarchical_memory_limit 2147483648 hierarchical_memsw_limit 4294967296 total_cache 1572868096 total_rss 147456 total_rss_huge 0 total_mapped_file 0 total_dirty 1572868096 total_writeback 0 total_swap 0 total_pgpgin 384470 total_pgpgout 433 total_pgfault 607 total_pgmajfault 0 total_inactive_anon 77824 total_active_anon 12288 total_inactive_file 1572864000 total_active_file 4096 total_unevictable 0

memory.stat文件中的cache字段添加了1.5g,而inactive_file字段為1.5g,因此,dd所產生的文件cache計算在inactive_file上。這就導致了所看到的容器內存的監控居高不下,因為cache是可重用的,并不能反映進程占用內存。

一般情況下,計算監控內存可根據計算公式:

active_anon + inactive_anon = anonymous memory + file cache for tmpfs + swap cache Therefore active_anon + inactive_anon ≠ rss, because rss does not include tmpfs. active_file + inactive_file = cache - size of tmpfs

所以實際內存使用計算為:

real_used = memory.usage_in_bytes - (active_file + inactive_file)

(1)準備tomcat鏡像和jmeter壓測工具,tomcat的yaml文件如下

apiVersion: extensions/v1beta1 kind: Deployment metadata: name: tomcat-deployment spec: replicas: 1 template: metadata: labels: app: tomcat spec: containers: - name: tomcat image: registy.dcos:8021/public/tomcat:8 ports: - containerPort: 8080 resources: limits: cpu: "1" memory: 300Mi --- apiVersion: v1 kind: Service metadata: labels: name: tomcat name: tomcat namespace: default spec: ports: - name: tomcat port: 8080 protocol: TCP targetPort: 8080 type: NodePort selector: app: tomcat

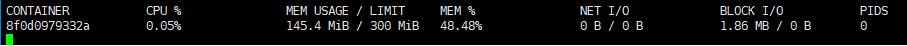

yaml文件中限制tomcat鏡像的使用內存為300Mi,執行命令生成文件。通過docker stats查看沒有負載情況下tomcat容器的內存占用。

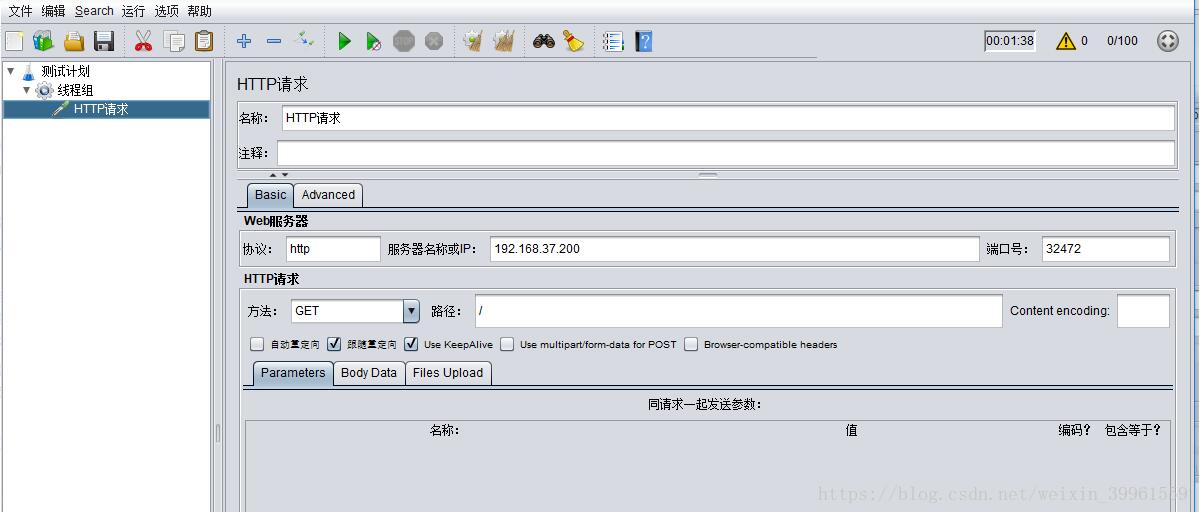

(2)提取tomcat的service nodePort端口

[docker@ecs-5f72-0006 ~]$ kubectl get svc tomcat -o=custom-columns=nodePort:.spec.ports[0].nodePort nodePort 31401

(3)登陸jmeter官網下載壓測工具

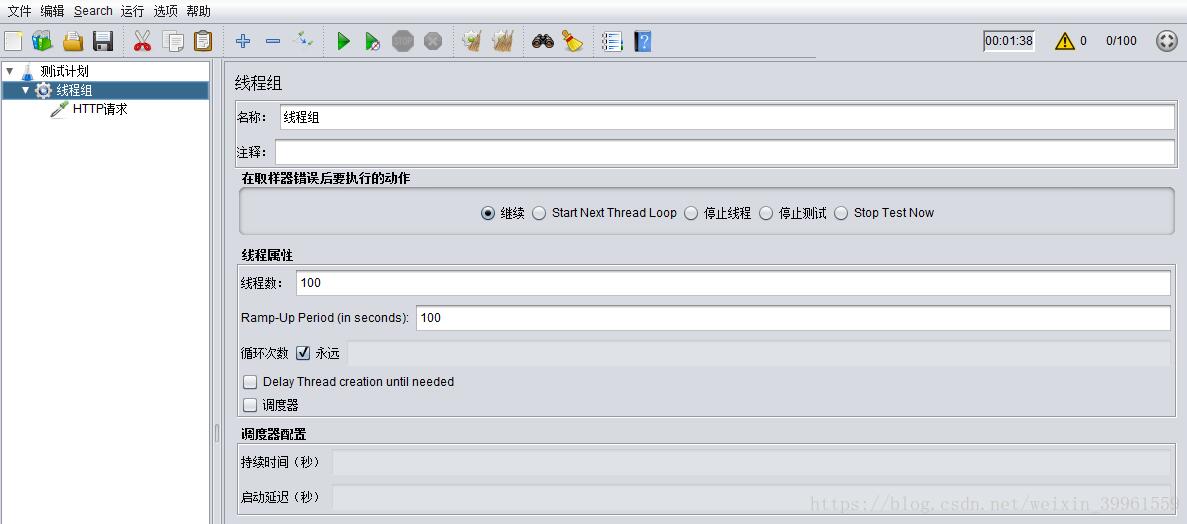

在windows上運行jmeter工具,到bin目錄點擊運行jmeter,配置jmeter如下:

配置好測試選項后點擊啟動按鈕開始壓測,通過docker stats查看容器內存使用情況發現已經到達限制。

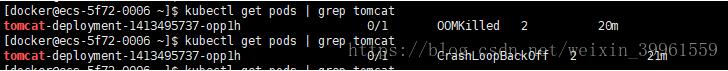

通過kubectl get pods查看pod的運行情況發現tomcat由于內存超過限制值被kill掉。

關于docker stats內存監控的問題一直存在,docker將cache/buffer納入內存計算引起誤解。docker內存的計算方式和linux的內存使用計算方式一致,也包含了cache/buffer。

但是cache是可重復利用的,經常使用在I/O請求上,使用內存來緩解可能被再次訪問的數據,為提高系統性能。

在官方github上,也有很多人提交了關于內存監控的issue,直到了Docker 17.06版本,docker stats才解決了這個問題。

但是這也僅僅是docker stats的顯示看起來正常了,而進入容器查看內存的使用還是包含的cache,如果直接使用cadvisor搜集的數據,還是會出現包含了cache的情況。

通過壓測docker,最后發現當壓測到程序的限制內存時,pod出現重啟,這也解釋了我們在使用docker監控時,即使內存占用99%+,卻不出現pod重啟的情況,這里面有相當一部分的內存是cache占用。

以上為個人經驗,希望能給大家一個參考,也希望大家多多支持腳本之家。如有錯誤或未考慮完全的地方,望不吝賜教。