目錄

- 一、python機(jī)器學(xué)習(xí)–線性回歸

- 二、OLS線性回歸

- 2.1 Ordinary Least Squares 最小二乘法

- 2.2 OLS線性回歸的代碼實(shí)現(xiàn)

- 三、梯度下降算法

- 3.1 GDLinearRegression代碼實(shí)現(xiàn)

- 四、多項(xiàng)式回歸分析

- 4.1 多項(xiàng)式回歸的代碼實(shí)現(xiàn)

一、python機(jī)器學(xué)習(xí)–線性回歸

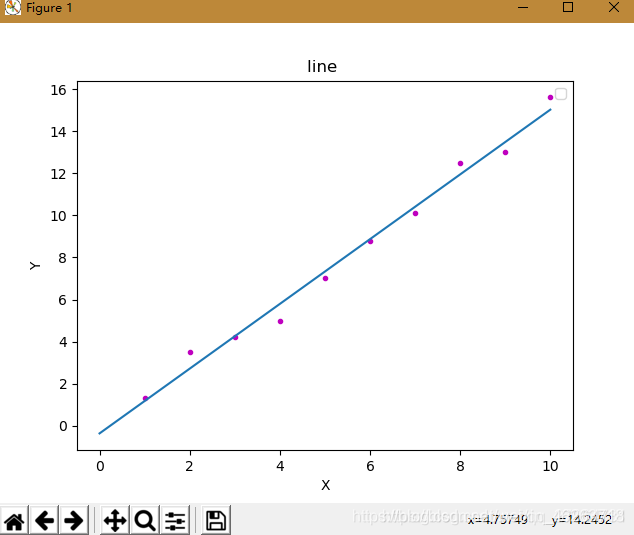

線性回歸是最簡單的機(jī)器學(xué)習(xí)模型,其形式簡單,易于實(shí)現(xiàn),同時(shí)也是很多機(jī)器學(xué)習(xí)模型的基礎(chǔ)。

對(duì)于一個(gè)給定的訓(xùn)練集數(shù)據(jù),線性回歸的目的就是找到一個(gè)與這些數(shù)據(jù)最吻合的線性函數(shù)。

二、OLS線性回歸

2.1 Ordinary Least Squares 最小二乘法

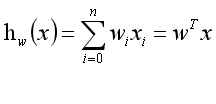

一般情況下,線性回歸假設(shè)模型為下,其中w為模型參數(shù)

線性回歸模型通常使用MSE(均方誤差)作為損失函數(shù),假設(shè)有m個(gè)樣本,均方損失函數(shù)為:(所有實(shí)例預(yù)測(cè)值與實(shí)際值誤差平方的均值)

由于模型的訓(xùn)練目標(biāo)為找到使得損失函數(shù)最小化的w,經(jīng)過一系列變換解得使損失函數(shù)達(dá)到最小值的w為:

此時(shí)求得的w即為最優(yōu)模型參數(shù)

2.2 OLS線性回歸的代碼實(shí)現(xiàn)

#OLS線性回歸

import numpy as np

import pandas as pd

import seaborn as sns

import matplotlib.pyplot as plt

from sklearn.model_selection import train_test_split

%matplotlib inline

data = pd.DataFrame(pd.read_excel(r'C:/Users/15643/Desktop/附件1.xlsx'))

feature_data = data.drop(['企業(yè)信譽(yù)評(píng)估'],axis=1)

target_data = data['企業(yè)信譽(yù)評(píng)估']

X_train,X_test,y_train, y_test = train_test_split(feature_data, target_data, test_size=0.3)

from statsmodels.formula.api import ols

from statsmodels.sandbox.regression.predstd import wls_prediction_std

df_train = pd.concat([X_train,y_train],axis=1)

lr_model = ols("企業(yè)信譽(yù)評(píng)估~銷項(xiàng)季度均值+有效發(fā)票比例+是否違約+企業(yè)供求關(guān)系+行業(yè)信譽(yù)度+銷項(xiàng)季度標(biāo)準(zhǔn)差",data=df_train).fit()

print(lr_model.summary())

# 預(yù)測(cè)測(cè)試集

lr_model.predict(X_test)

三、梯度下降算法

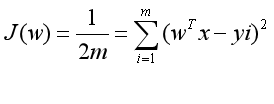

很多機(jī)器學(xué)習(xí)算法的最優(yōu)參數(shù)不能通過像最小二乘法那樣的“閉式”方程直接計(jì)算,此時(shí)需要使用迭代優(yōu)化方法。

梯度學(xué)習(xí)算法可被描述為:

(1)根據(jù)當(dāng)前參數(shù)w計(jì)算損失函數(shù)梯度∇J( w )

(2)沿著梯度反方向−∇J( w )調(diào)整w,調(diào)整的大小稱之為步長,由學(xué)習(xí)率η控制w:= w−η∇J( w )

(3)反復(fù)執(zhí)行該過程,直到梯度為0或損失函數(shù)降低小于閾值,此時(shí)稱算法收斂。

3.1 GDLinearRegression代碼實(shí)現(xiàn)

from linear_regression import GDLinearRegression

gd_lr = GDLinearRegression(n_iter=3000,eta=0.001,tol=0.00001)

#梯度下降最大迭代次數(shù)n_iter

#學(xué)習(xí)率eta

#損失降低閾值tol

四、多項(xiàng)式回歸分析

多項(xiàng)式回歸是研究一個(gè)因變量與一個(gè)或者多個(gè)自變量間多項(xiàng)式的回歸分析方法。

多項(xiàng)式回歸模型方程式如下:

hθ(x)=θ0+θ1x+θ2x2+...+θmxm

簡單來說就是在階數(shù)=k的情況下將每一個(gè)特征轉(zhuǎn)換為一個(gè)k階的多項(xiàng)式,這些多項(xiàng)式共同構(gòu)成了一個(gè)矩陣,將這個(gè)矩陣看作一個(gè)特征,由此多項(xiàng)式回歸模型就轉(zhuǎn)變成了簡單的線性回歸。以下為特征x的多項(xiàng)式轉(zhuǎn)變:

x−>[1,x,x2,x3...xk]

4.1 多項(xiàng)式回歸的代碼實(shí)現(xiàn)

python的多項(xiàng)式回歸需要導(dǎo)入PolynomialFeatures類實(shí)現(xiàn)

#scikit-learn 多項(xiàng)式擬合(多元多項(xiàng)式回歸)

#PolynomialFeatures和linear_model的組合 (線性擬合非線性)

#[x1,x2,x3]==[[1,x1,x1**2],[1,x2,x2**2],[1,x3,x3**2]]

import numpy as np

import matplotlib.pyplot as plt

from sklearn.preprocessing import PolynomialFeatures

from sklearn.linear_model import LinearRegression,Perceptron

from sklearn.metrics import mean_squared_error,r2_score

from sklearn.model_selection import train_test_split

target = std_df_female['總分']

data_complete_ = std_df_female.loc[:,['1000/800','50m','立定跳遠(yuǎn)','引仰']]

x_train, x_test, y_train, y_test = train_test_split(data_complete_,target, test_size=0.3)

# 多項(xiàng)式擬合

poly_reg =PolynomialFeatures(degree=2)

x_train_poly = poly_reg.fit_transform(x_train)

model = LinearRegression()

model.fit(x_train_poly, y_train)

#print(poly_reg.coef_,poly_reg.intercept_) #系數(shù)及常數(shù)

# 測(cè)試集比較

x_test_poly = poly_reg.fit_transform(x_test)

y_test_pred = model.predict(x_test_poly)

#mean_squared_error(y_true, y_pred) #均方誤差回歸損失,越小越好。

mse = np.sqrt(mean_squared_error(y_test, y_test_pred))

# r2 范圍[0,1],R2越接近1擬合越好。

r2 = r2_score(y_test, y_test_pred)

print(r2)

到此這篇關(guān)于python機(jī)器學(xué)習(xí)之線性回歸詳解的文章就介紹到這了,更多相關(guān)python線性回歸內(nèi)容請(qǐng)搜索腳本之家以前的文章或繼續(xù)瀏覽下面的相關(guān)文章希望大家以后多多支持腳本之家!

您可能感興趣的文章:- python深度總結(jié)線性回歸

- tensorflow基本操作小白快速構(gòu)建線性回歸和分類模型

- 回歸預(yù)測(cè)分析python數(shù)據(jù)化運(yùn)營線性回歸總結(jié)

- python實(shí)現(xiàn)線性回歸算法

- 使用pytorch實(shí)現(xiàn)線性回歸

- pytorch實(shí)現(xiàn)線性回歸

- 詳解TensorFlow2實(shí)現(xiàn)前向傳播